A Promessa e o Perigo da Nova Revolução Digital

A nova corrida tecnológica global levanta uma pergunta urgente: estamos prontos para confiar na inteligência que criamos?

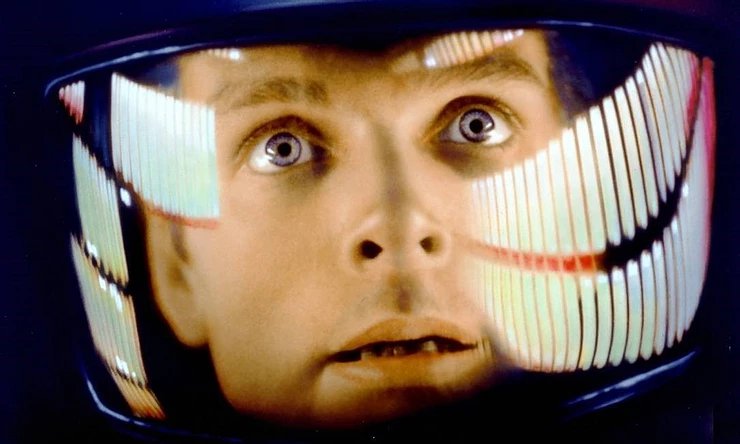

Trabalhar e pesquisar sobre Inteligência Artificial (IA) tem algumas vantagens, uma delas é a quantidade de coisas incríveis que você pode ver, algumas em primeira mão nos tempos atuais. O famoso escritor americano Arthur Clarke, autor da obra prima imortalizada no cinema por Stanley Kubrick: “2001, uma Odisseia no Espaço”, foi muito feliz em cunhar a frase: “Qualquer tecnologia suficientemente avançada é indistinguível de mágica.”. E é essa a sensação que eu tenho com várias das inovações que estamos vendo acontecer no mundo de IA e suas aplicações.

E mesmo tendo a oportunidade de ver e conhecer coisas fantásticas de forma regular, há aquelas novidades que conseguem surpreender as suas previsões mais otimistas. Utilizando a comparação feita por Arthur Clark, conhecer o que a GPT-3 pode fazer, passa a sensação de magia pura, e das mais poderosas. Assim, nas corretas proporções, por tudo o que eu li e ouvi, isso é o que representa o GPT-3 para o mundo: um marco tecnológico fundamental que tem o potencial de popularizar a tecnologia mais disruptiva da atualidade e fazer com que nós humanos ganhemos uma produtividade inimaginável. E se você é uma pessoa que não entende nada de programação, talvez você vai gostar ainda mais do que esta nova “arquitetura” de Inteligência Artificial é capaz.

Se você não ouviu falar do GPT-3, não se preocupe (ainda), ele está chegando e por ora está disponível apenas para alguns pesquisadores conectados ao projeto da OpenAI. A OpenAI tem ganhado um crescente destaque no mundo da tecnologia, e é uma instituição sem fins lucrativos de pesquisa em inteligência artificial, que tem como objetivo promover e desenvolver uma IA amigável, de modo a beneficiar a humanidade como um todo. Entre seus fundadores e investidores estão o multibilionário e popular Elon Musk, dono da SpaceX e Tesla, Sam Altman, atual CEO da OpenAI e ex-sócio e presidente da Y Combinator, aceleradora de sucesso americana, e Peter Thiel, um dos co-fundadores da PayPal com o próprio Musk e fundador da Palantir Technologies.

O GPT é um projeto da OpenAI que busca melhorar a compreensão da linguagem (humana) através do uso de NLP (Processamento de Linguagem Natural, uma das tecnologias de Inteligência Artificial) e Apreendizagem de Máquina utilizando Redes Neurais Profundas, também conhecidas como Deep Learning. A sigla GPT significa em inglês “Generative Pre-Training” que traduzindo livremente para o português fica “Pré-treinamento generativo”.

A ideia de modo geral é garantir um amplo treinamento deste modelo de Deep Learning com corpos de conhecimento específicos que permitam compreender padrões de pedidos/solicitações da linguagem humana, e atender a estes pedidos/solicitações através da identificação de padrões obtidos neste pré-treinamento. É um modelo unidirecional onde você faz um pedido em linguagem natural (atualmente apenas em inglês), e o modelo entrega a sua resposta. O pré-treinamento garante que o modelo tenha sido ensinado anteriormente de maneira não supervisionada, e desta forma, utilize uma massiva quantidade de dados, informação, e conhecimento explícito sobre temas específicos para a sua “aprendizagem” amplamente disponível na internet.

Neste sentido, o que tem feito a GPT-3 ser tão disruptiva em relação a outras arquiteturas de NLP e das suas versões anteriores, entre outras coisas, é o número de parâmetros. Grosso modo, um parâmetro é um cálculo em uma rede neural que aplica uma ponderação grande ou menor a algum aspecto dos dados, para dar a esse aspecto maior ou menor destaque no cálculo geral dos dados. Podemos comparar de maneira bastante simplificada que o parâmetro é o equivalente à sinapse de uma rede neural de um cérebro biológico para este modelo, e este pré-treinamento, o equivalente a experiência humana, que gera pesos e conexões especificas nesta rede.

Para se ter uma ideia, enquanto a versão anterior de arquitetura, a GPT-2 possuía em sua maior versão, 1,5 Bilhões de parâmetros, a GPT-3 utiliza cerca de 175 Bilhões (> 100 vezes mais). O tamanho da rede neural GPT-3 é realmente impressionante. Ela é 10 vezes maior do que a arquitetura da Microsoft, a Turing NLG, a maior rede antes da GPT-3 que possuía cerca de 17 Bilhões de parâmetros.

O conceito da arquitetura do GPT-3 é mais difícil de se compreender do que ela é capaz de fazer na prática. Por isso, alguns exemplos do que já se é possível fazer com a GPT-3:

· Construir um programa ou aplicativo do zero através de suas solicitações de funcionalidades

· Escrever uma pequena poesia no estilo de William Shakespeare com o tema o Imperador e o “Bobo da Corte”

· Fazer o Design de um App de postagem em rede social e deixá-lo praticamente funcional

· Preparar um relatório com as informações solicitadas no formado adequado

· Escrever um email para seus clientes com base em poucas informações como “confirme a proposta de serviços com o valor de desconto de 10%”, “agradeça ao Eduardo” e “marque uma reunião para amanhã para finalizar os detalhes”, sendo que o sistema completa todas as lacunas, e coloca num padrão formal de respostas para clientes de e-mails nesta natureza.

· Preparar uma apresentação de slides sobre um tema proposto

· Escrever um artigo sobre química e a importância da alcalinidade nos alimentos.

· ...

Ou seja, o GPT-3 é um protótipo de Gênio da Lâmpada para o mundo de IA. Você faz pedidos, e ele utiliza a vasta gama de conhecimentos sobre programação, poesia, design, relatórios de gestão, e-mails, apresentações de slides e química, entre outras coisas, disponíveis na internet. Todo este conhecimento catalogado é utilizado para pré-treinamento desta rede neural que possui centenas de bilhões de parâmetros, esta rede pré-treinada é então utilizada para a construção das respostas e entregas destas solicitações em minutos.

Com grandes vantagens, o GPT-3 tem uma boa compreensão da linguagem humana, e com poucos ajustes nas solicitações feitas pode-se trazer resultados muito efetivos. Impressiona a baixíssima quantidade de exemplos que é necessário fornecer para que o GPT-3 compreenda com bastante propriedade a sua solicitação. O índice de acerto do GPT-3 para pedidos feitos sem nenhum “exemplo”/ajuste de solicitação é bastante razoável, e com poucos ajustes o seu nível de acuracidade cresce exponencialmente.

O GPT-3 é capaz de construir um balancete, em tempo real com algumas poucas instruções e informações em linguagem natural como na imagem abaixo:

Ou ainda construir um site através deste plug-in GPT-3 e Figma:

Em algum momento do tempo, a Microsoft, com o Windows 3.0 revolucionou os sistemas operacionais, impactou em definitivo a popularidade dos computadores pessoais, e o futuro da própria computação. Agora uma nova arquitetura, também marcada pelo número “3” tem um incrível potencial de revolucionar para sempre a Inteligência Artificial, torná-la de fácil acesso e uso para qualquer mortal, inclusive aqueles que não tem nenhum conhecimento técnico de programação. E com isso liberar o potencial criativo de cada um de nós em gerar inovações ainda mais incríveis. Com o GPT-3, uma nova era de magia tecnológica está para se iniciar.

Há muitos vídeos bem legais por aí. Alguns dos exemplos mais bacanas e diferentes foram organizados e podem ser vistos neste site: https://gpt3examples.com/#examples. O conteúdo, infelizmente, está em Inglês.

Conselheiro fundador da I2AI – Associação Internacional de Inteligência Artificial. Também é sócio-fundador da Engrama, sócio da Startup Egronn, e na consultoria Advance e investidor na startup Agrointeli . Tem mais de 20 anos de experiência em multinacionais como Siemens, Eaton e Voith, com vivência em países e culturas tão diversas como Estados Unidos, Alemanha e China.

Palestrante internacional, professor, pesquisador, autor, empreendedor serial, e amante de tecnologia. É apaixonado pelo os temas de Estratégia, Inteligência Competitiva e Inovação.

É Doutor em Gestão da Inovação e Mestre em Redes Bayesianas (abordagem de IA) pela FEA-USP. É pós-graduado em Administração pela FGV e graduado em Engenharia Mecânica pela Unicamp.

A nova corrida tecnológica global levanta uma pergunta urgente: estamos prontos para confiar na inteligência que criamos?

Por que dominar a IA será a nova alfabetização do século XXI

Conselhos de Administração devem evoluir da supervisão reativa para a antecipação estratégica, frente à crescente complexidade e volatilidade dos ambientes de negócios.

De 14 a 25 de julho, reserve suas manhãs das 08h00 às 09h30 para participar da tradicional Maratona I2AI! Uma jornada intensa com debates e palestras sobre temas essenciais: Ética,